본 문서에서는 2023년 ICLR학회에서 발표된 "Divide to Adapt: Mitigating Confirmation Bias for Domain Adaptation of Black-box Predictors" 논문을 소개합니다. 논문에 대한 상세한 정보는 다음과 같습니다.

- Title: Divide to Adapt: Mitigating Confirmation Bias for Domain Adaptation of Black-box Predictors

- Authors: Jianfei Yang, Xiangyu Peng, Kai Wang, Zheng Zhu, Jiashi Feng, Lihua Xie, Yang You

- Conference: International Conference on Learning Representations (ICLR) 2023

Domain Adaptation with Black-Box Predictors

Domain adaptation with black-box predictors (DABP)는 black-box source model이 주어진 상황에서 unsupervised domain adaptation을 해결하는 문제입니다. Black-box model이란 입력 데이터가 있을 때 모델 아웃풋만 얻을 수 있고 모델 내부의 구조나 파라미터는 접근할 수 없기 때문에 모델을 학습하지 못하는 제한점이 있습니다. 기존 DABP 방법은 주로 지식 증류(Knowledge Distillation)를 통해 블랙박스 모델에서 얻은 아웃풋을 pseudo label로 하고 타겟 모델을 학습합니다. 그러나 소스와 타겟 도메인의 도메인 차이로 인하여 예측 노이즈가 생성됩니다. 이러한 예측 노이즈가 누적되어 확인 편향 (confirmation bias)을 야기시키고 이는 모델 성능을 저하시킵니다. 때문에 모델 아웃풋인 예측 노이즈에서 비롯되는 확인 편향을 줄이는 것이 매우 중요합니다. 또한, 타겟 도메인에는 적응이 쉬운 인스턴스와 어려운 인스턴스가 혼재되어 있어, 이를 효과적으로 분리하고 적응하는 것이 중요한 과제입니다. 본 논문에서는 divide-to-adapt 전략을 제안하여 교차 도메인을 통한 지식 증류를 진행합니다. 이를 위해, 초기 단계에서 타겟 도메인을 노이즈가 상대적으로 적은 easy-to-adapt 하위 도메인과 더 어려운 hard-to-adapt 하위 도메인으로 나누고 이후 반지도 학습을 통해 적응합니다.

Proposed Method

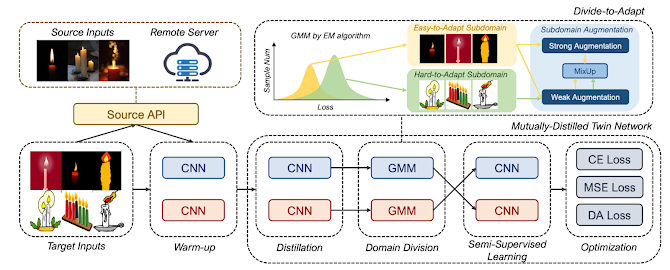

그림 1. BETA 구조.

BETA의 핵심 아이디어는 DABP의 확인 편향을 완화하기 위해 타겟 도메인을 적응 난이도에 따라 두 하위 도메인으로 분할하는 것입니다. 그림 1에서 볼 수 있듯이 BETA는 노이즈 누적을 억제하기 위해 두 가지 설계에 의존합니다. 첫째로, 도메인 분할 모듈이 타겟 도메인을 더 clean한 하위 도메인으로 정화하고 DABP를 반지도 학습 작업으로 전환합니다. 둘째로, 두 네트워크 메커니즘은 정보 교환을 통해 자체 훈련 오류를 더욱 줄이는 데 기여합니다. DABP 문제의 챌린지 및 BETA의 핵심 아이디어는 다음과 같습니다.

C1: DABP에서 확인 편향으로 인해 소스 분류기의 강한 예측에 의존하여 자체 훈련 오류가 누적되는 문제

A1: 대상 도메인을 쉽게 적응 가능한 하위 도메인과 어렵게 적응 가능한 하위 도메인으로 나누어 차이를 활용

C2: 더 쉽게 적응 가능한 하위 도메인에서 잘못된 레이블에 대한 과적합으로 인한 확인 편향

A2: Mutually-distilled Twin Network (MTN)을 도입하여 두 네트워크를 동시에 훈련시켜 서로의 오류를 정화, 서로 다른 방식으로 하위 도메인을 보강하여 다양성 향상

[Domain Division]

기존 연구에서 딥러닝 모델은 주로 소스 도메인과 유사한 easy-to-adapt instance에 먼저 적응하는 경향이 있습니다. 때문에 쉽운/어려운 도메인으로 분류하여 학습하는것이 중요하고, 실험을 통해 두가지 도메인에 해당하는 instance의 loss 분포가 다르다는것을 확인 하였습니다. 따라서 본 논문에서는 타겟 데이터를 두가지 도메인으로 나누기 위하여 loss distribution을 활용합니다. Loss 분포를 통해 얻은 관찰에 기반하여 네트워크를 몇 에폭 동안 워밍업하고 K-way 분류 문제에 대한 각 instance의 cross-entropy loss을 계산하여 loss 분포를 얻습니다. Loss 분포는 bimodal로 나타나며 두 피크는 clean하거나 noisy한 클러스터를 나타내기 때문에 Expectation Maximization (EM)을 사용하여 Gaussian Mixture Model (GMM)로 적합시킬 수 있습니다. Loss 분포를 비대칭 노이즈와 더 잘 맞추기 위해 워밍업 단계에서 negative 엔트로피가 정규화로 사용됩니다.

[Mutually-distilled Twin Networks with Subdomain Augmentation]

도메인 분할을 통해 정화된 easy-to-adapt 서브도메인은 여전히 피할 수 없는 잘못된 레이블을 가지고 있습니다. 이러한 잘못된 레이블에 과적합되면 모델이 도메인 분할에 대해 허위로 낮은 손실을 생성하고 이를 반복적으로 축적하여 확인 편향이 발생합니다. 본 연구에서는 서로 다른 네트워크 간의 상호 훈련을 통해 자기 교육의 확인 편향을 줄이기 위해 MTN을 제안합니다. 이를 위해 독립적으로 초기화된 두 개의 동일한 네트워크를 사용하며, 한 네트워크는 다른 네트워크의 도메인 분할 및 pseudo 레이블에 따라 반지도 학습을 수행합니다. 이러한 방식으로 두 네트워크가 상호적으로 훈련되어 오류를 필터링하는 추가 감독을 받습니다.

[Algorithmic Instantiation]

2가지 메인 아이디어 외 기존 연구에 많이 사용된 hard knowledge distillation, mutual information maximisation, Mixup, domain alignment 등 기법을 추가적으로 사용하여 성능을 향상시킵니다. 자세한 내용은 논문을 참고하기 바랍니다.

Experiments

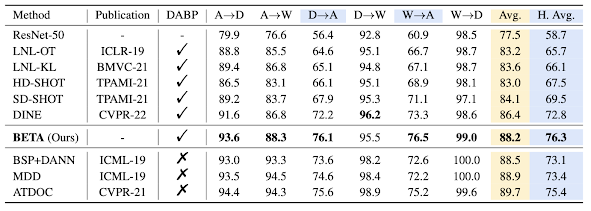

본 논문에서 제안한 BETA 방법의 유효성을 검증하기 위하여 기존 기법들과 비교 실험을 진행합니다. 그림 2는 Office31 데이터셋의 결과를 보여주는데 기존 기법등과 비교하였을 때 최고의 성능을 달성하였고 평균적으로 1.8% 성능향상이 있습니다. 그외 Office-Home, VisDA-17, DomainNet 등 벤치마크에서 실험을 진행하였는데 논문을 참고하기 바랍니다.

그림 2. BETA와 경쟁 방법들의 성능 비교.

BETA의 주요 구성 요소의 효과는 그림3에서 보여주고 있습니다. 도메인 분할에 의해 활성화된 반지도 학습 loss가 소스만 있는 모델을 11.4% 향상시키는 것을 확인할 수 있습니다. MTN, KD 및 MI는 각각 0.6%, 1.1%, 0.9%의 성능 향상이 있습니다. 타겟 도메인에서 가져온 두 하위 도메인이 매우 유사하기 때문에 분포 불일치가 항상 효과적이지 않습니다.

그림 3. Ablation study.

Conclusion

본 논문은 " Divide to Adapt: Mitigating Confirmation Bias for Domain Adaptation of Black-box Predictors"로, 도메인 간 지식 전이의 확인 편향을 완화하는 BETA 프레임워크를 제안하였습니다. BETA의 핵심 아이디어는 도메인을 쉽게 적응 가능한 하위 도메인과 어렵게 적응 가능한 하위 도메인으로 나누는데 이를 통해 도메인 간 편향을 줄이고, 반지도 학습과정으로 모델을 적응시키는 것입니다. 실험을 통하여 다양한 벤치마크에서 BETA가 최고의 성능을 보임을 보여주었습니다.

본 논문은 보안성 문제로 소스 데이터나 소스 모델을 직접 사용할 수 없는 상황에서 전이학습을 적용하려는 분류 모델에 적용이 가능합니다. 예를 들어, A 병원에서 환자 CT 사진은 있지만 해당 레이블이 없을 경우, B 병원에서 이미 학습된 분류 모델을 제공받아 모델을 학습할 수 있습니다. 하지만 B 병원의 경우 모델을 그대로 넘겨주었을 때 adversarial learning을 사용하여 데이터를 환원할 가능성이 있기 때문에, 환자 개인 정보 등 문제로 인하여 모델을 sealing하여 보내주는것이 안전합니다. 이런 경우에 DABP 문제가 발생하고 BETA는 모델 성능을 향상하는데 사용될 수 있습니다.

데이터 마이닝 연구실에서는 DABP 기법들을 포함한 전이학습 관련 연구들을 활발하게 진행하고 있습니다. 특히, 기존 DABP 기법들의 경우 클래스별로 다른 도메인의 적응 난이도를 고려하지 못하고, 적응이 어려운 데이터들이 충분히 활용되지 못한다는 단점이 있기에 이러한 부분을 해결하는 연구를 진행중입니다.